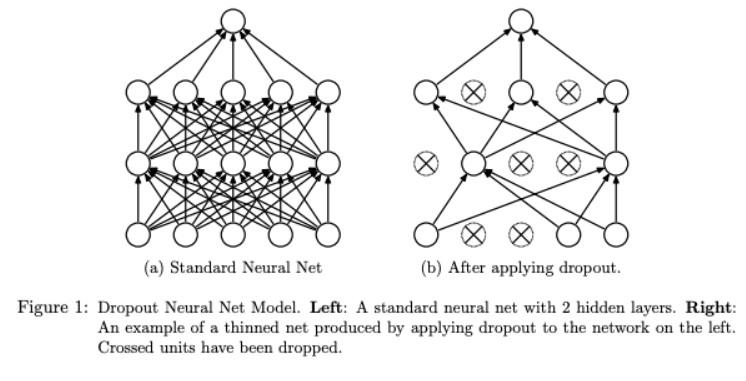

Dropout:過学習を回避するためにランダムにニューロンを「ドロップアウト」させる方法。ドロップアウトはアンサンブル学習を行っていることになる。

ニューラルネットワークにおいて重み更新の際にランダムで枝を無効化することで過学習を抑える手法。

過学習を抑制する方法として、Dropoutが提案されています。Dropoutは特定のレイヤーの出力を学習時にランダムで0に落とすことで、一部のデータが欠損していても正しく認識ができるようにします。これにより、画像の一部の局所特徴が過剰に評価されてしまうのを防ぎ、モデルのロバストさを向上させることができます。

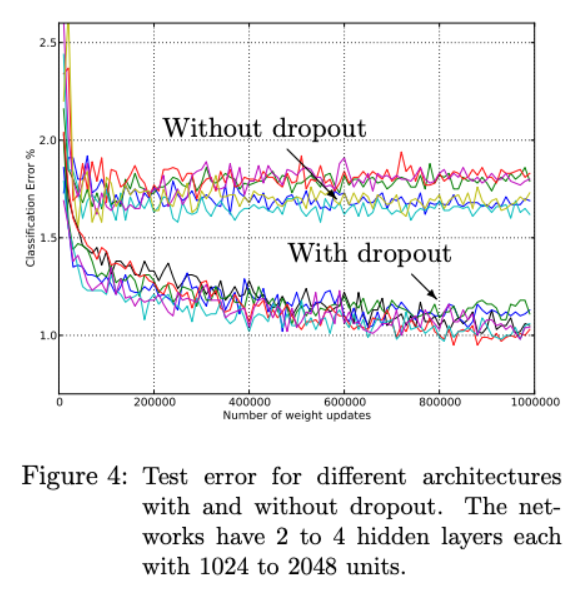

下記のグラフはDropoutの論文に掲載されている実験結果です。without dropoutに比べて、with dropoutではEPOCHを重ねても過学習を抑制でき、エラーレートを落としていくことができています。