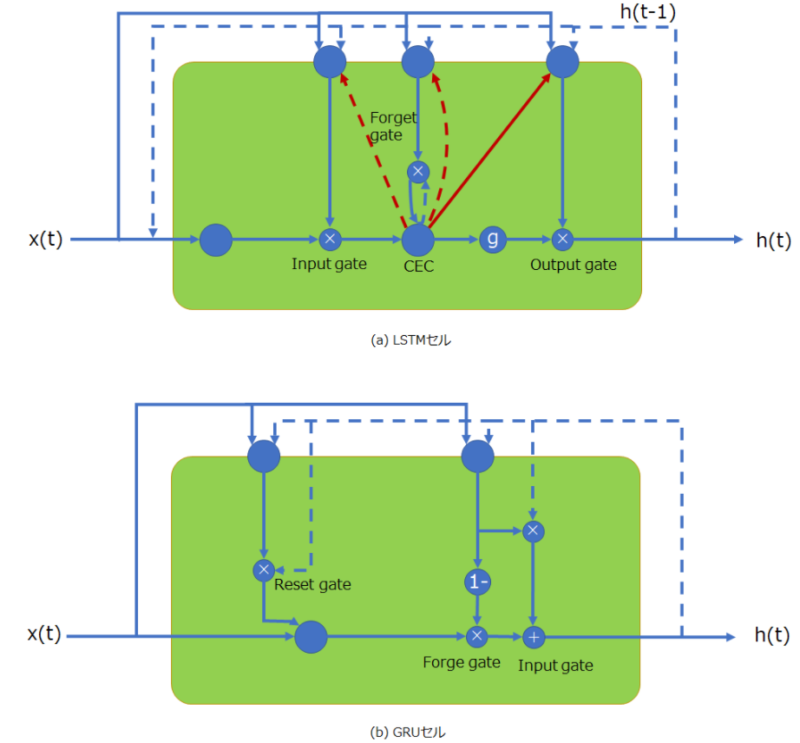

Gated Recurrent Unit:LSTMを簡略化したモデル。リセットゲート、更新ゲートを用いる。

GRU(Gated Recurrent Unit)セルは、LSTMと同様の性能を持つとされており、LSTMより計算量が少なく、高速に学習を進めることができます。

LSTMはRNNで不可能だった長期的特徴の学習を可能にしたセルですが、計算コストが大きいという問題点があります。

- 状態ベクトル数を減らす(時間依存の状態数を減らす)

LSTMではCECとhの2つが状態を保持していました。これを1つにまとめます。

これにより、記憶セルという構造は無くなります。 - ゲートコントローラ数を減らす

LSTMでは入力ゲート、忘却ゲート、出力ゲートに1つずつゲートコントローラが必要でした。そこで、忘却ゲートと入力ゲートの操作を1つのコントローラで操作するように変更します。 - CECとhをまとめたため、出力ゲートによる出力制限は望ましくない。すなわち、出力ゲートの仕組みを取り除く。

- 出力ゲートを取り除くと、重み衝突が発生する可能性があるため、入力値を求めるニューロンに再帰される経路上にリセットゲートを設ける。