正しい選択肢は:

④ (A)中間層 (B)0

解説:

ReLU(Rectified Linear Unit)関数とは:

ReLUは、ニューラルネットワークにおける活性化関数の1つで、以下の特徴を持ちます:

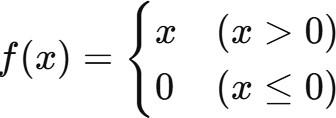

式:

入力が正の値の場合はそのまま出力し、入力が0以下の場合は0を出力します。

シンプルで計算コストが低く、勾配消失問題を緩和する効果があるため、中間層(隠れ層)でよく使用されます。

空欄の解説:

(A)中間層

・ReLUは主に中間層で用いられる活性化関数です。

・出力層では、タスクに応じてソフトマックス関数やシグモイド関数が選ばれることが一般的です。

(B) 0

他の選択肢の誤り:

① (A)中間層 (B)|x|

・誤り:ReLUは負の値を0に変換するため、負の値が絶対値に変換されることはありません。

➁ (A)出力層 (B) 0

・誤り:ReLUは通常、中間層で使用されます。出力層ではタスクに応じて他の関数が使われることが多いです。

➂ (A)出力層 (B)|x|

・誤り:ReLUの特性に合わず、また出力層で使用するのも不適切です。